Dal campo di battaglia fisico alla fabbrica algoritmica

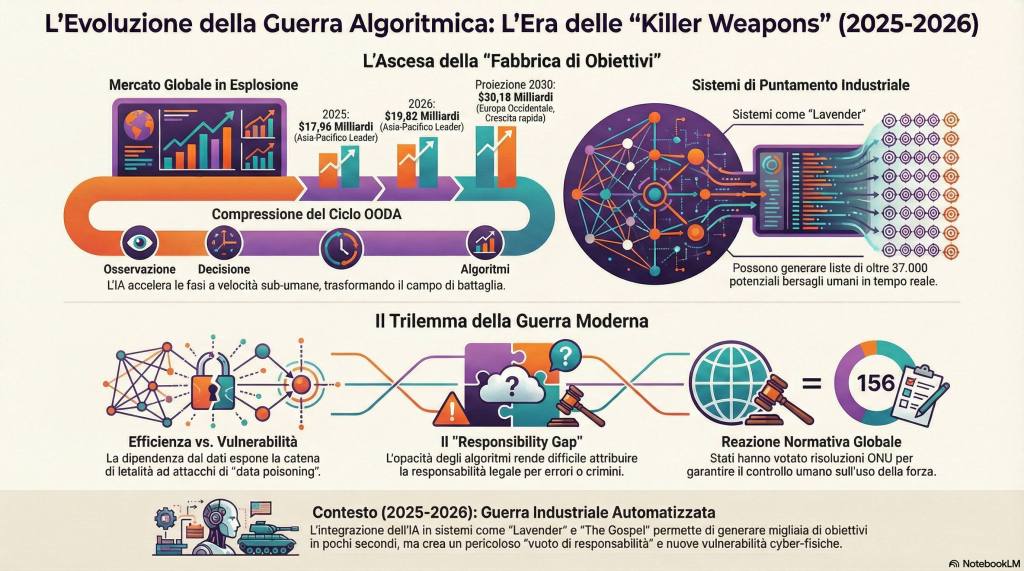

Il panorama bellico contemporaneo sta attraversando una rivoluzione cognitiva che segna il passaggio definitivo dalla Network-Centric Warfare alla Algorithmic-Centric Warfare. In questo nuovo paradigma, l’Intelligenza Artificiale (IA) non è più un semplice strumento di supporto, ma emerge come il motore decisionale centrale della “kill chain” (catena letale). Questa evoluzione impone una OODA loop compression senza precedenti: il ciclo “osserva-orienta-decidi-agisci” viene accelerato a velocità macchina, trasformando l’ingaggio dei bersagli in un processo di rendimento cinetico industrializzato.

L’adozione del concetto di “Fabbrica Algoritmica”, cristallizzatosi durante il conflitto di Gaza (2023-2025), descrive la trasformazione della guerra in un’impresa guidata dai dati su scala di massa. Questa accelerazione verso l’efficienza estrema ha generato una rottura strategica, in cui la superiorità militare non dipende più solo dalla potenza di fuoco, ma dalla capacità di elaborazione algoritmica. Tuttavia, tale velocità crea una collisione inevitabile tra l’efficacia tattica e la legittimità normativa, rendendo il fronte mediorientale il laboratorio critico per le future dottrine di guerra globale.

Il modello israeliano: L’automazione delle “Kill List” (Habsora e Lavender)

La rottura strategica del 7 ottobre 2023 ha agito da catalizzatore per l’integrazione totale di sistemi Agentic AI nella dottrina dell’IDF. Per gestire un ambiente di minaccia asimmetrica ad alta densità, Israele ha implementato uno stack sociotecnico a due livelli progettato per generare obiettivi a ritmi industriali.

I due pilastri fondamentali del sistema sono:

- The Gospel (Habsora): Un sistema di raccomandazione basato sull’IA dedicato al targeting infrastrutturale. Elabora flussi massicci di SIGINT (Signals Intelligence) e GEOINT (Geospatial Intelligence) per proporre bersagli (edifici, tunnel, centri di comando) classificati per probabilità di rilevanza militare.

- Lavender: Rappresenta il salto qualitativo verso il targeting “person-centric”. Utilizzando il machine learning per analizzare i pattern comportamentali e i metadati di comunicazione, Lavender ha generato una “kill list” di circa 37.000 potenziali bersagli umani.

L’aspetto più critico di questa “fabbrica” è l’istituzionalizzazione di soglie di danno collaterale pre-autorizzate: secondo fonti d’intelligence, i comandanti hanno stabilito parametri che consentono l’uccisione di 15-20 civili per ogni operativo di basso rango identificato dal sistema. Questa automazione estrema ha generato un profondo “Responsibility Gap”: con analisti umani chiamati a validare decine di obiettivi all’ora, il ruolo dell’uomo scivola verso un mero “human-on-the-loop”. L’operatore agisce spesso vittima di un automation bias, ratificando in pochi secondi decisioni algoritmiche probabilistiche che eludono i criteri tradizionali di distinzione e proporzionalità del Diritto Internazionale Umanitario.

Oltre Anduril: I giganti globali e l’architettura della guerra robotica

Mentre pionieri come Anduril hanno imposto il primato del software, i competitor internazionali stanno integrando l’IA in piattaforme hardware pesanti per risolvere il problema del Combat Mass in contesti di declino demografico. La sfida odierna è il paradigma “One-to-Many”, dove un singolo operatore deve poter gestire interi sciami autonomi per compensare la carenza di personale.

| Azienda/Paese | Sistema/Piattaforma | Funzionalità Core |

| Hanwha (Corea del Sud) | Heavy UGV (Type I & II) | Veicoli da 35t diesel-ibridi. Type I (H-UGV 30) per supporto fanteria; Type II (H-UGV 105) con cannone ad alta pressione per fuoco diretto. |

| Norinco (Cina) | P60 / Robot Dogs | Veicoli multiruolo (50 km/h) alimentati da DeepSeek AI su chip Huawei per sovranità algoritmica; cani robot Unitree per sminamento. |

| Sukhoi (Russia) | S-70 Okhotnik-B | Drone stealth pesante progettato come “Loyal Wingman” per il caccia Su-57, capace di estendere la portata radar e d’ingaggio del pilota. |

| Ghost Robotics (USA) | Vision 60 Q-UGV | Robot quadrupedi dotati di un nuovo braccio manipolatore a 6 gradi di libertà (DoF) per operazioni indoor e apertura porte. |

| Rheinmetall/MBDA (UE) | Laser Joint Venture | Sistemi laser ad alta energia (HEL) per la difesa di punto contro droni agili, testati con successo in contesti navali e terrestri. |

L’analisi strategica rivela che, senza l’automazione “uno-a-molti”, gli UGV rimangono vincolati a un rapporto operatore-macchina 1:1, fallendo l’obiettivo di moltiplicatore di massa. La sovranità militare risiede ora esclusivamente nella resilienza del software e del compute.

La strategia USA: Accelerazione e tensioni con la Silicon Valley

Nel gennaio 2026, il Pentagono ha lanciato la sua “AI Acceleration Strategy”, imponendo una forza “AI-first”. La dottrina si basa sul principio che la velocità è la strategia stessa, ma questa spinta ha creato un conflitto frontale con le Big Tech, in particolare con Anthropic.

Il conflitto si articola su tre punti di attrito:

- Il requisito “All Lawful Purposes”: Il Dipartimento della Difesa (DoD) esige che i modelli (come Claude) siano utilizzabili per ogni scopo legale, inclusa l’autonomia letale.

- Le “Linee Rosse” di Anthropic: L’azienda rifiuta di permettere l’uso dell’IA per sorveglianza di massa e autonomia letale assoluta senza supervisione.

- Il Paradosso del Rischio: Il Pentagono ha minacciato di designare Anthropic come “Supply Chain Risk”. Questo creerebbe un paradosso strategico: ogni contractor del DoD dovrebbe smettere di usare Claude, danneggiando la stessa Difesa USA, dato che il modello è già integrato nello stack di Palantir utilizzato in operazioni critiche (come la cattura di Nicolás Maduro nel gennaio 2026).

Per superare i colli di bottiglia dell’interfaccia umana, il Pentagono ha lanciato il progetto Orchestrator (un tender da 100 milioni di dollari). L’obiettivo è il controllo vocale degli sciami di droni in “inglese semplice”, permettendo a un solo soldato di gestire formazioni complesse senza interfacce ingombranti.

Il paradosso della “Fabbrica Fragile”: Vulnerabilità cyber-fisiche

L’efficienza della guerra algoritmica nasconde una fragilità intrinseca: il sistema è un’enorme superficie di attacco digitale dove la corruzione dei dati è letale quanto un proiettile.

- Data Poisoning: Un avversario consapevole delle “firme digitali” può attuare uno spoofing comportamentale, manipolando le attività civili affinché corrispondano ai pattern dei combattenti registrati da sistemi come Lavender, “hackerando” la logica di targeting dall’esterno.

- Spoofing e Decezione: L’uso di segnali contraffatti o deepfake geo-spaziali può indurre gli algoritmi di tracciamento a colpire bersagli errati o a ignorare minacce reali.

- Dipendenza Infrastrutturale: La dipendenza da chip Nvidia o infrastrutture cloud globali trasforma la sicurezza nazionale in una variabile della geopolitica aziendale. Se un fornitore sospende il supporto, la capacità di difesa di una nazione può essere paralizzata istantaneamente.

L’ultima barriera: Deumanizzazione digitale e il trilemma della guerra

La reazione normativa internazionale ha raggiunto il culmine il 6 novembre 2025, con l’adozione della Risoluzione ONU L.41 (156 voti a favore). Questa mossa riflette un “Corrosive Normative Backlash” guidato dalla campagna “Stop Killer Robots” contro la deumanizzazione digitale, ovvero la riduzione del valore umano a un punteggio statistico probabilistico.

Il futuro della sicurezza globale dipende dalla risoluzione del Trilemma Strategico:

- Efficienza tattica: La necessità di operare a velocità macchina per sopravvivere.

- Resilienza sistemica: La protezione delle catene di comando digitali da attacchi cyber.

- Legittimità normativa: Il rispetto dei principi del Diritto Internazionale Umanitario, che richiedono un giudizio soggettivo umano.

L’IA depoliticizza la violenza trasformandola in un output tecnico, distanziando psicologicamente gli agenti umani dall’atto di uccidere e rendendo la nebbia della guerra un’opacità algoritmica totale.

Il futuro della guerra nel Secolo esponenziale

La transizione verso la guerra autonoma suggerisce che una vittoria nell’elaborazione dei dati potrebbe tradursi in una sconfitta nella legittimità strategica. Il vantaggio militare nel ventunesimo secolo non apparterrà a chi possiede la “fabbrica” più veloce, ma a chi saprà integrare queste tecnologie senza erodere la base della responsabilità umana.

“Il vantaggio militare non apparterrà a chi ha la fabbrica più veloce, ma a chi risolverà il trilemma tra efficienza e responsabilità.”

“La dipendenza da infrastrutture digitali globali trasforma la sicurezza nazionale in una funzione della resilienza del software.”

“L’automazione della morte richiede una nuova fluenza etica per evitare che la nebbia della guerra diventi un’opacità algoritmica totale.”