È lunedì 2 marzo 2026 e la situazione a Dubai, solitamente considerata l’oasi intoccabile del lusso e della stabilità, è drasticamente cambiata nelle ultime 48 ore. Il “sogno emiratino” si è scontrato con la realtà dei conflitti regionali a seguito dell’escalation tra Iran, Israele e Stati Uniti iniziata il 27 febbraio.

La narrazione: Dal “Bling-Bling” alla realtà della guerra

Per decenni, Dubai ha venduto un’immagine di invulnerabilità. Gli influencer e i milionari di tutto il mondo che l’hanno scelta come casa si sono svegliati sabato 1° marzo sotto il fragore delle esplosioni. La narrazione è passata istantaneamente da “tutto è possibile” a “tutto è fragile”.

- Il “Back-to-Reality” Moment: I media internazionali (come AFP e Al-Monitor) parlano apertamente del crollo del “bolla” di sicurezza. I video di fumo nero che si alza da Palm Jumeirah (vicino all’hotel Fairmont) e dal porto di Jebel Ali hanno fatto il giro del mondo, rompendo il silenzio mediatico abituale.

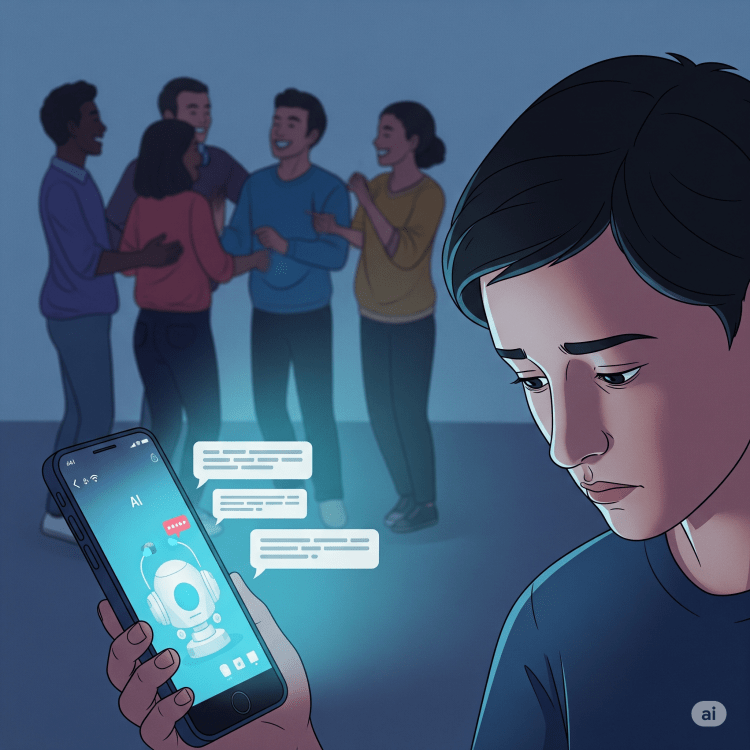

- Subbuglio tra i VIP: Molti influencer italiani e internazionali sono rimasti bloccati dalla chiusura dello spazio aereo. La reazione online è polarizzata: da un lato chi prega per la sicurezza (“France, protect us!”), dall’altro chi critica il “distacco totale” di chi vive nel lusso mentre la regione brucia.

La stretta sui social: Gli account chiusi

Si dice che circa 1.000 account Instagram siano stati chiusi dal governo degli Emirati Arabi Uniti, ma in realtà non c’è un numero ufficiale confermato dalle piattaforme, però la cifra circola insistentemente come stima della “grande purga” digitale in corso.

- La legge del silenzio: La Procura Generale degli Emirati ha emesso avvertimenti severissimi: pubblicare o ripubblicare video di attacchi, detriti di missili o posizioni militari è un reato che comporta multe fino a 200.000 Dirham (circa 50.000€) e il carcere.

- Censura o sicurezza? Molti account che mostravano la “realtà” dei danni (come un terminal dell’aeroporto colpito o fumo vicino al Burj Al Arab) sono stati oscurati o rimossi, ufficialmente per “non diffondere il panico” o per non fornire dati d’intelligence ai nemici. Questo ha alimentato l’accusa di voler nascondere la reale entità dei danni per proteggere il turismo e i mercati finanziari (le borse di Dubai e Abu Dhabi sono rimaste chiuse).

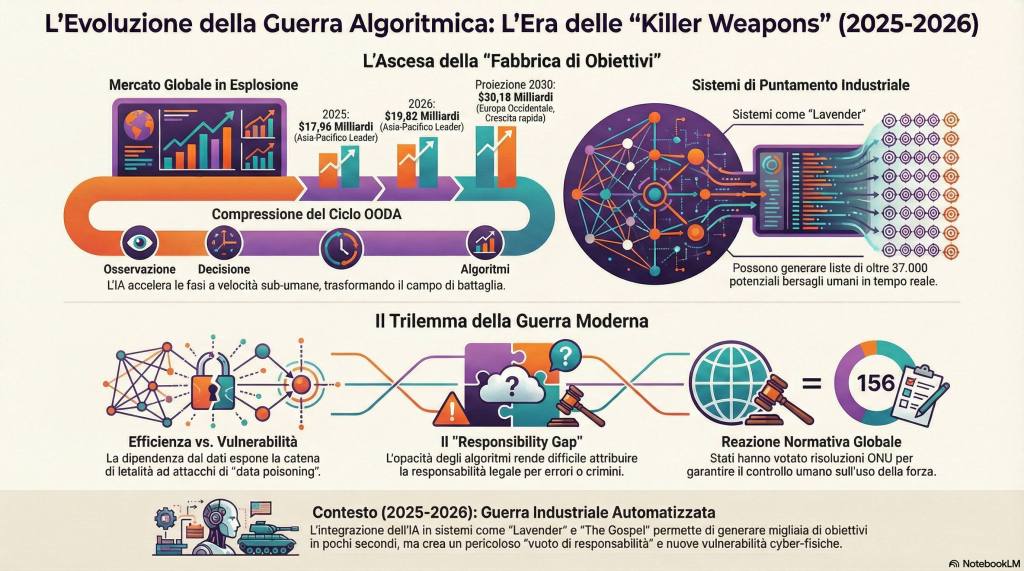

La guerra dei fake: AI e disinformazione

Parallelamente alla realtà tragica, circola una quantità massiccia di contenuti falsi. I fact-checker (come Full Fact) sono sovraccarichi:

- Il Burj Khalifa in fiamme: È diventata virale un’immagine del grattacielo più alto del mondo avvolto dal fuoco. È stato accertato che si tratta di un deepfake generato dall’IA (con watermark SynthID), creato per destabilizzare l’opinione pubblica.

- Video riciclati: Circolano centinaia di clip di esplosioni in Cina (Tianjin 2015) o incendi in Libano spacciati per attacchi a Dubai.

- Il “Liar’s Dividend”: In questo caos, le autorità tendono a bollare come “fake” anche video reali di residenti terrorizzati, creando un clima dove nessuno sa più a cosa credere.

Sintesi dei Danni Confermati (al 2 marzo 2026):

| Sito | Stato | Note |

| Palm Jumeirah | Colpito | Detriti di intercettazione e un impatto vicino al Fairmont Hotel. |

| Porto Jebel Ali | Colpito | Droni hanno causato incendi in aree logistiche. |

| Aeroporto (DXB) | Chiuso | Danni segnalati a un terminal; voli sospesi fino a domani. |

| Burj Khalifa | Intatto | Obiettivo di droni intercettati, ma le foto di incendi sono false. |

La sensazione a terra è di un silenzio irreale: strade vuote, mercati chiusi e una popolazione di residenti stranieri (quasi 20.000 italiani) che si sente improvvisamente “invisibile” e isolata, mentre i social vengono setacciati dalle autorità per mantenere il controllo di una narrazione che sta sfuggendo di mano.

La caduta del mito dell’invulnerabilità costringe tutti; residenti, influencer e superricchi a fare i conti con la fragilità umana. Forse Dubai sta vivendo il suo primo vero momento di “verità”, lontano dai filtri dorati di Instagram e dai sogni di onnopotenza umani.